2017年世界機(jī)器人大會(huì)在北京盛大舉行,來自全球的頂尖機(jī)器人匯聚一堂,展示了機(jī)械科技的最新成果。在這場(chǎng)科技盛宴中,多款機(jī)器人憑借其卓越的性能和創(chuàng)新的設(shè)計(jì)成為當(dāng)之無愧的“明星”。

由波士頓動(dòng)力公司帶來的SpotMini四足機(jī)器人驚艷全場(chǎng)。這款機(jī)器人不僅能自如上下樓梯,還能在復(fù)雜環(huán)境中穩(wěn)定行走,其靈活性和平衡性令人嘆為觀止。SpotMini的機(jī)械臂可以精準(zhǔn)抓取物體,展現(xiàn)了機(jī)器人在家庭服務(wù)領(lǐng)域的巨大潛力。

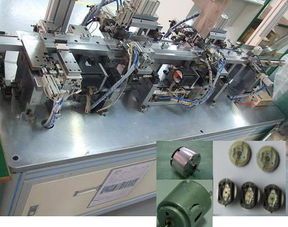

來自瑞士的ABB公司推出的YuMi雙臂協(xié)作機(jī)器人同樣備受矚目。YuMi具備極高的精準(zhǔn)度,能夠完成精細(xì)的裝配工作,其柔軟的機(jī)械臂設(shè)計(jì)確保了與人類安全協(xié)作。這款機(jī)器人在工業(yè)制造領(lǐng)域展現(xiàn)出革命性的應(yīng)用前景。

醫(yī)療機(jī)器人領(lǐng)域也不乏亮點(diǎn)。達(dá)芬奇手術(shù)機(jī)器人系統(tǒng)展示了其在微創(chuàng)手術(shù)中的卓越表現(xiàn),通過高清3D視覺系統(tǒng)和精細(xì)的機(jī)械臂控制,大大提升了手術(shù)的精準(zhǔn)度和安全性。

大會(huì)還展出了多款服務(wù)型機(jī)器人,如優(yōu)必選的Alpha 2人形機(jī)器人,能歌善舞,可與人類進(jìn)行自然互動(dòng);還有科沃斯的掃地機(jī)器人,展現(xiàn)了智能家居的便捷應(yīng)用。

2017世界機(jī)器人大會(huì)不僅是一場(chǎng)視覺盛宴,更是機(jī)械科技發(fā)展的風(fēng)向標(biāo)。這些“明星”機(jī)器人不僅展示了當(dāng)前技術(shù)的最高水平,更為我們描繪了一幅機(jī)器人融入日常生活、助力產(chǎn)業(yè)升級(jí)的美好藍(lán)圖。